Kaka カカ字幕アシスタント

音声認識、字幕のセグメンテーション、最適化、翻訳をサポートするLLM駆動のビデオ字幕処理アシスタント。

Kaka 字幕アシスタント(VideoCaptioner)は操作が簡単で、高性能なハードウェアを必要としません。音声認識のためのオンラインAPI呼び出しとローカルオフライン処理(GPUサポートあり)の両方をサポートしています。大規模言語モデル(LLM)を活用して、インテリジェントな字幕のセグメンテーション、修正、翻訳を行います。ビデオ字幕のワークフロー全体をワンクリックで解決します!あなたのビデオに素晴らしい字幕を追加しましょう。

最新バージョンでは、VAD、ボーカル分離、単語レベルのタイムスタンプ、バッチ字幕処理、その他の実用的な機能をサポートしています。

- 🎯 強力な音声認識エンジンを使用するためにGPUは不要で、正確な字幕生成が可能です。

- ✂️ LLMベースのインテリジェントなセグメンテーションと文の分割で、より自然な字幕の読み取りを実現。

- 🔄 AI字幕のマルチスレッド最適化と翻訳、字幕形式の調整、表現をより慣用的かつプロフェッショナルに。

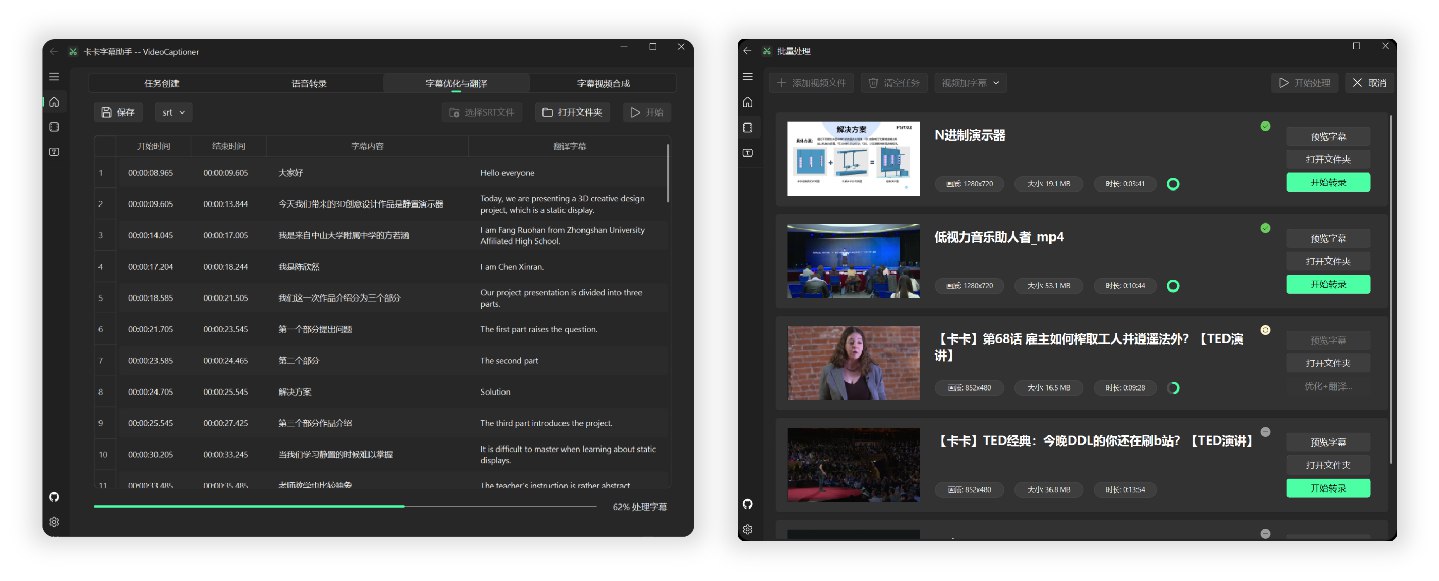

- 🎬 バッチビデオ字幕合成をサポートし、処理効率を向上。

- 📝 直感的な字幕編集と表示インターフェース、リアルタイムプレビューと迅速な編集をサポート。

- 🤖 低モデルトークン消費、基本的なLLMモデルを内蔵し、すぐに使用可能。

14分の1080P Bilibiliの英語TEDビデオをエンドツーエンドで処理し、ローカルWhisperモデルを使用して音声認識を行い、gpt-4o-miniモデルを使用して中国語に最適化および翻訳するのに約3分かかりました。

バックエンドの計算に基づくと、モデルの最適化と翻訳のコストは¥0.01未満でした(OpenAIの公式価格を使用して計算)。

字幕とビデオ合成の詳細な結果については、TEDビデオテストを参照してください。

このソフトウェアは軽量で、パッケージサイズは60MB未満であり、必要な環境がすべて含まれています。ダウンロードして直接実行できます。

-

リリースページから最新バージョンの実行ファイルをダウンロードします。または:Lanzou Cloud Download

-

インストーラーを開いてインストールします。

-

(オプション)LLM API設定、字幕の最適化または翻訳を有効にするかどうかを選択します。

-

ソフトウェアウィンドウにビデオファイルをドラッグアンドドロップして、完全自動処理を行います。

注意:各ステップは独立した処理とファイルのドラッグアンドドロップをサポートしています。

MacOSユーザー向け

開発者がMacを持っていないため、MacOSでのテストとパッケージ化ができません。MacOS用の実行ファイルは一時的に利用できません。

Macユーザーは、ソースコードをダウンロードし、Pythonの依存関係をインストールして実行してください。(ローカルWhisper機能は現在MacOSではサポートされていません。)

- ffmpegとAria2ダウンロードツールをインストール

brew install ffmpeg brew install aria2 brew install python@3.**

- プロジェクトをクローン

git clone https://github.com/WEIFENG2333/VideoCaptioner.git

cd VideoCaptioner

- 依存関係をインストール

python3.** -m venv venv

source venv/bin/activate

pip install -r requirements.txt

- プログラムを実行

python main.py

Docker デプロイメント (ベータ版)

現在のアプリケーションは比較的基本的なものです。PRの貢献を歓迎します。

git clone https://github.com/WEIFENG2333/VideoCaptioner.git

cd VideoCaptioner

docker build -t video-captioner .

カスタムAPI設定で実行:

docker run -d \

-p 8501:8501 \

-v $(pwd)/temp:/app/temp \

-e OPENAI_BASE_URL="Your API address" \

-e OPENAI_API_KEY="Your API key" \

--name video-captioner \

video-captioner

ブラウザを開いて、http://localhost:8501にアクセスしてください。

- コンテナにはffmpegなどの必要な依存関係がすでに含まれています。

- 他のモデルを使用する必要がある場合は、環境変数を通じて設定してください。

このソフトウェアは、大規模言語モデル(LLM)の文脈理解の利点を最大限に活用し、音声認識で生成された字幕をさらに処理します。誤字を効果的に修正し、用語を統一し、字幕の内容をより正確で一貫性のあるものにし、ユーザーに優れた視聴体験を提供します!

- 国内外の主流のビデオプラットフォーム(Bilibili、YouTubeなど)をサポート

- ビデオの元の字幕を自動的に抽出して処理します。

- Jianyingに匹敵する効果を持つ複数のオンライン認識インターフェースを提供(無料、高速)。

- ローカルWhisperモデルをサポート(プライバシー保護、オフライン)。

- 用語、コードスニペット、数式のフォーマットを自動的に最適化。

- 読みやすさを向上させるための文脈的な文の分割最適化。

- 原稿プロンプトをサポートし、元の原稿や関連するプロンプトを使用して字幕のセグメンテーションを最適化。

- 文脈を考慮したインテリジェントな翻訳により、翻訳が全体のテキストを考慮することを保証。

- プロンプトを通じて大規模モデルに翻訳を反映させ、翻訳の質を向上。

- シーケンスのあいまい一致アルゴリズムを使用して、タイムラインの完全な一貫性を保証。

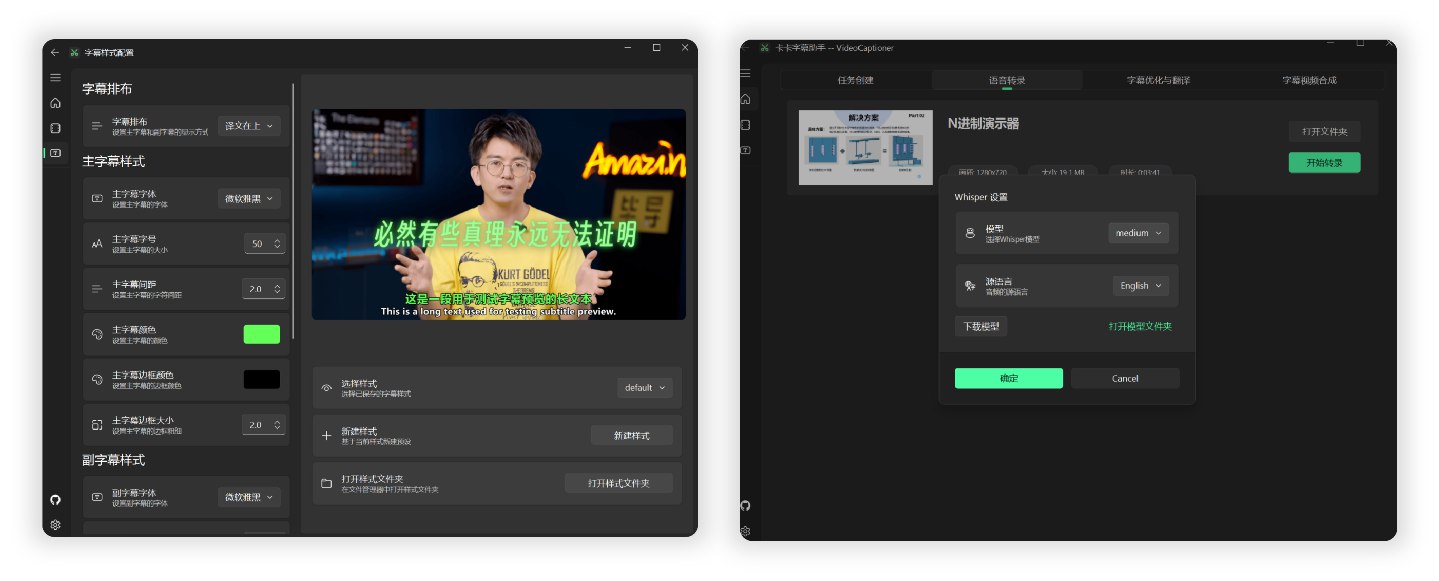

- 豊富な字幕スタイルテンプレート(科学スタイル、ニューススタイル、アニメスタイルなど)。

- 複数の字幕ビデオ形式(SRT、ASS、VTT、TXT)。

| 設定項目 | 説明 |

|---|---|

| 内蔵モデル | ソフトウェアには基本的な大規模言語モデル(gpt-4o-mini)が含まれており、設定なしで使用可能です(公共サービスは不安定です)。 |

| APIサポート | 標準のOpenAI API形式をサポート。 SiliconCloud、DeepSeek、Ollamaなどと互換性があります。 設定方法については、設定ドキュメントを参照してください。 |

推奨モデル:より高品質を求める場合は、Claude-3.5-sonnetまたはgpt-4oを選択してください。

Whisperには2つのバージョンがあります:WhisperCppとfasterWhisper(推奨)。後者はより良いパフォーマンスを持ち、どちらもソフトウェア内でモデルをダウンロードする必要があります。

| モデル | ディスク容量 | メモリ使用量 | 説明 |

|---|---|---|---|

| Tiny | 75 MiB | ~273 MB | トランスクリプションは平均的で、テストのみを目的としています。 |

| Small | 466 MiB | ~852 MB | 英語の認識はすでに良好です。 |

| Medium | 1.5 GiB | ~2.1 GB | 中国語の認識にはこのバージョンが最低限推奨されます。 |

| Large-v1/v2 👍 | 2.9 GiB | ~3.9 GB | 良好なパフォーマンスを持ち、設定が許すなら推奨されます。 |

| Large-v3 | 2.9 GiB | ~3.9 GB | コミュニティのフィードバックによると、幻覚/字幕の繰り返しの問題がある可能性があります。 |

推奨モデル:Large-v1は安定しており、品質が良好です。

注意:上記のモデルは、ソフトウェア内で直接ダウンロード可能で、国内ネットワークを使用し、GPUと統合グラフィックスの両方をサポートしています。

- 「字幕の最適化と翻訳」ページには「原稿マッチング」オプションがあり、以下の1つ以上のタイプのコンテンツをサポートして字幕の修正と翻訳を支援します:

| タイプ | 説明 | 例 |

|---|---|---|

| 用語集 | 用語、名前、特定の単語の修正表。 | 机器学习->Machine Learning 马斯克->Elon Musk 打call -> Cheer on Turing patterns Bus paradox |

| 元の字幕テキスト | ビデオの元の原稿または関連するコンテンツ。 | 完全なスピーチスクリプト、講義ノートなど。 |

| 修正要件 | コンテンツに関連する特定の修正要件。 | 人称代名詞の統一、用語の標準化など。 コンテンツに関連する要件を記入してください。例の参照 |

- 字幕の最適化に原稿の支援が必要な場合は、まず原稿情報を記入し、タスク処理を開始してください。

- 注意:コンテキストが限られている小さなLLMモデルを使用する場合、原稿の内容は1000語以内にすることをお勧めします。より大きなコンテキストウィンドウを持つモデルを使用する場合は、原稿の内容を適切に増やすことができます。

| インターフェース名 | 対応言語 | 実行方式 | 説明 |

|---|---|---|---|

| インターフェースB | 中国語、英語 | オンライン | 無料、高速 |

| インターフェースJ | 中国語、英語 | オンライン | 無料、高速 |

| WhisperCpp | 中国語、日本語、韓国語、英語、その他99の言語。外国語に対して良好なパフォーマンス。 | ローカル | (実際の使用は不安定)トランスクリプションモデルのダウンロードが必要。 中国語:中型以上のモデルを推奨。 英語など:小型モデルでも良好な結果が得られます。 |

| fasterWhisper 👍 | 中国語、英語、その他99の言語。外国語に対して優れたパフォーマンス、より正確なタイムライン。 | ローカル | (🌟非常に推奨🌟)プログラムとトランスクリプションモデルのダウンロードが必要。 CUDAをサポートし、より高速で正確なトランスクリプション。 非常に正確なタイムスタンプ字幕。 これを優先して使用してください。 |

URLダウンロード機能を使用する際に以下の状況に遭遇した場合:

- ビデオサイトがダウンロードにログイン情報を要求する。

- 低解像度のビデオしかダウンロードできない。

- ネットワーク状況が悪いときに認証が必要。

- Cookie設定手順を参照して、cookie情報を取得し、

cookies.txtファイルをソフトウェアのインストールディレクトリのAppDataディレクトリに配置して、高品質のビデオを通常通りダウンロードしてください。

プログラムの簡単な処理フローは以下の通りです:

音声認識 -> 字幕セグメンテーション(オプション) -> 字幕の最適化と翻訳(オプション) -> 字幕とビデオの合成

ソフトウェアをインストールした後の主なディレクトリ構造は以下の通りです:

VideoCaptioner/ ├── runtime/ # ランタイム環境ディレクトリ(変更しないでください) ├── resources/ # ソフトウェアリソースファイルディレクトリ(バイナリ、アイコンなど、およびダウンロードされたfaster-whisperプログラム) ├── work-dir/ # 作業ディレクトリ、処理されたビデオと字幕ファイルが保存されます ├── AppData/ # アプリケーションデータディレクトリ ├── cache/ # キャッシュディレクトリ、トランスクリプションと大規模モデルのリクエストデータをキャッシュします。 ├── models/ # Whisperモデルファイルを保存 ├── logs/ # ログディレクトリ、ソフトウェアの実行状態を記録 ├── settings.json # ユーザー設定を保存 └── cookies.txt # ビデオプラットフォームのcookie情報(高解像度ビデオのダウンロードに必要) └── VideoCaptioner.exe # メインプログラム実行ファイル

-

字幕セグメンテーションの品質は視聴体験にとって非常に重要です。このため、SubtitleSpliterを開発しました。これは、単語ごとの字幕を自然言語の習慣に従って段落に再編成し、ビデオフレームと完全に同期させることができます。

-

処理中、タイムライン情報なしでテキストコンテンツのみが大規模言語モデルに送信され、処理のオーバーヘッドが大幅に削減されます。

-

翻訳段階では、Andrew Ngが提案した「翻訳-反映-翻訳」手法を採用しています。この反復的な最適化方法は、翻訳の正確性を保証します。

作者は大学3年生で、個人の能力とプロジェクトにはまだ多くの改善の余地があります。プロジェクトは継続的に改善中で、使用中にバグに遭遇した場合は、Issueの提出とPull Requestによるプロジェクト改善へのご協力をお願いします。

2024.1.22

- コードアーキテクチャの完全なリファクタリング、全体的なパフォーマンスの最適化

- 字幕の最適化と翻訳機能モジュールを分離し、より柔軟な処理オプションを提供

- バッチ処理機能を追加:バッチ字幕、バッチトランスクリプション、バッチ字幕ビデオ合成をサポート

- UIインターフェースとインタラクションの詳細を包括的に最適化

- LLMサポートの拡大:SiliconCloud、DeepSeek、Ollama、Gemini、ChatGLMなどのモデルを追加

- 複数の翻訳サービスを統合:DeepLx、Bing、Google、LLM

- faster-whisper-large-v3-turboモデルのサポートを追加

- 複数のVAD(音声活動検出)メソッドを追加

- カスタム反映翻訳スイッチをサポート

- 字幕セグメンテーションはセマンティック/文モードをサポート

- 字幕セグメンテーション、最適化、翻訳のプロンプトを最適化

- 字幕とトランスクリプションのキャッシュメカニズムを最適化

- 中国語字幕の自動改行を改善

- 垂直字幕スタイルを追加

- 字幕タイムライン切り替えメカニズムを改善し、ちらつき問題を解消

- Whisper APIが使用できない問題を修正

- 複数の字幕ビデオ形式をサポート

- 一部のケースでのトランスクリプションエラーの問題を修正

- ビデオ作業ディレクトリ構造を最適化

- ログ表示機能を追加

- タイ語、ドイツ語などの言語の字幕最適化を追加

- 多くのバグを修正...

2024.12.07

- Faster-whisper対応を追加、音声から字幕への変換品質向上

- Vad音声区切り検出対応、幻聴現象を大幅に削減

- 音声分離対応、動画のバックグラウンドノイズを分離

- 動画合成の無効化に対応

- 字幕最大長設定を追加

- 字幕末尾の句読点削除設定を追加

- 最適化と翻訳のプロンプトを改善

- LLMの字幕分割エラーを改善

- 音声変換フォーマットの不一致問題を修正

2024.11.23

- Whisper-v3モデル対応を追加、音声認識精度を大幅に向上

- 字幕分割アルゴリズムを最適化、より自然な読書体験を提供

- モデル利用可能性チェック時の安定性問題を修正

2024.11.20

- 字幕位置とスタイルのカスタマイズに対応

- 字幕最適化と翻訳プロセスのリアルタイムログ表示を追加

- API使用時の自動翻訳問題を修正

- 動画作業ディレクトリ構造を最適化、ファイル管理効率を向上

2024.11.17

- バイリンガル/モノリンガル字幕の柔軟なエクスポートに対応

- 原稿マッチングプロンプト整列機能を追加

- 字幕インポート時の安定性問題を修正

- 非中国語パスでのモデルダウンロードの互換性問題を修正

2024.11.13

- Whisper API呼び出し対応を追加

- cookie.txtのインポートで各種動画プラットフォームのリソースダウンロードに対応

- 字幕ファイル名を動画と自動的に一致

- ソフトウェアメインページにランタイムログのリアルタイム表示を追加

- ソフトウェア内部機能を統一化し完備

このプロジェクトがお役に立てましたら、Starを付けていただけると幸いです。それが私にとって最大の励みとサポートになります!